尽管外界有人高呼百度在追随特斯拉,但与后者完全摒弃激光雷达的激进方案相比,百度并不排斥激光雷达的存在。事实上,百度此时推出Apollo Lite或许只是想进一步训练视觉算法,推进感知融合方案的进化。

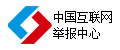

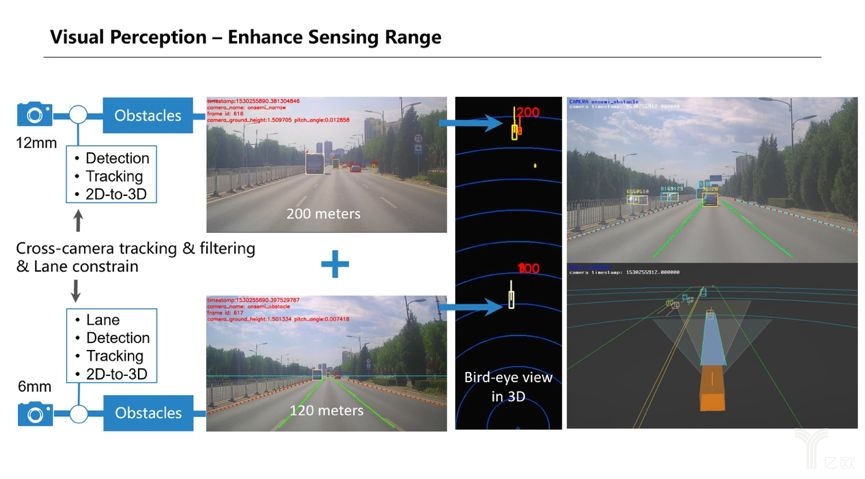

对于公司在CVPR 2019论坛期间公布的L4级自动驾驶纯视觉城市道路闭环解决方案——Apollo Lite,百度方面给出了这样的解释:“这是目前国内唯一的城市道路L4级视觉感知解决方案。”百度Apollo技术委员会主席王亮说道,“方案能够支持对10路摄像头、200帧/秒数据量的并行处理,单视觉链路最高丢帧率能够控制在5‰以下,实现全方位360°实时环境感知,前向障碍物的稳定检测视距达到240米。”

他表示,经过前期的技术研发投入和2019年上半年的路测迭代,依靠这套10相机的感知系统,百度无人车已可以在城市道路上实现不依赖高线数旋转式激光雷达的端到端闭环自动驾驶。目前,Apollo Lite已在北京稻香湖等多地多路段落地测试。

乍一看,百度好像已经追随特斯拉,放弃激光雷达,转身拥抱纯视觉感知路线。但王亮对此表示否定,他称:“百度下决心投入资源研发纯视觉感知解决方案并不意味着放弃现有基于激光雷达的技术路线,而是在技术实践过程中充分意识到无人驾驶系统冗余(true redundancy)的必要性,决定通过压强环视视觉技术来夯实多传感器融合感知框架。”

换句话讲,Apollo Lite的推出只是为了更好打磨百度的视觉技术。

目前业内普遍认为感知是实现L4级自动驾驶的至关重要环节,因此由于可以获得极高分辨率(角度、距离以及速度)、能在短时间内掌握可观的数据信息量等特点,激光雷达常常被认为是L4级自动驾驶不可或缺的一大元件,大多数企业也选择以激光雷达为主、视觉为辅的传感器融合策略。

但完美的多传感器融合方案,是需要各类传感器起到“精确”辅助作用的。在激光雷达为主的方案下,视觉传感器自身问题和缺陷暴露的还不够充分,难以真正训练算法。

百度表示,现今很多传感器融合的方案设计较为复杂,技术人员往往从快速解决问题的角度出发设计算法,这个过程中难免避重就轻地利用异构数据各自的优势进行缺陷互补从而绕过困难的问题。基于这种思路设计的多传感器融合方案可以在短期规避单传感器方案难以解决的问题,但长远看,数据和策略间深度耦合的设计不利于为环境感知系统提供真正意义上的冗余(true redundancy)。

为训练视觉传感器,更为提供冗余与安全,百度推出Apollo Lite,希望通过打磨迭代的纯视觉技术来反哺多传感器融合解决方案,提升无人驾驶系统的鲁棒性和安全性。

王亮重申:“百度Apollo始终坚持多传感器融合的技术路线。在L4级自动驾驶传感器选型上,激光雷达和摄像头不是排它的,也不是单纯的从属和互补关系。从安全性考虑,二者具备相同的重要性和不可替代性,缺一不可。”

百度并没有放弃激光雷达为主的多传感器融合方案。但不久前陆续推出L3级自动驾驶解决方案的纽劢科技、AutoBrain等初创企业,为降低成本达到量产要求,均已摒弃激光雷达,采用纯视觉感知方案,甚至以ADAS地图代替高精地图。

对于亟待量产和难度相对较低的L3级自动驾驶技术来讲,摒弃激光雷达似乎是一种可行方案。但对于L4级自动驾驶技术而言,大部分业内人士认为激光雷达还是不可或缺的存在。此前,有业内人士表示,当自动驾驶技术发展到一定高度,激光雷达价格就会下探,但一方面技术迭代需要时间,另一方面没人知道当自动驾驶汽车达到多少辆后激光雷达价格才会降低。而更便宜的激光雷达才会增加更多量产可能性。

站在L3和L4的交界点上推出Apollo Lite,百度的这一步不仅是想更好打磨多传感器融合方案,更是为以后纯视觉感知方案准备弹药。

转载请注明出处。

相关文章

相关文章

热门资讯

热门资讯

精彩导读

精彩导读

关注我们

关注我们